Sztuczna inteligencja stale zwiększa swoje możliwości i technologię. Undress AI to jeden z przykładów, który może narazić młodych ludzi na krzywdę.

Dowiedz się, co to jest, aby lepiej chronić swoje dziecko w Internecie.

Podsumowanie

- Undress AI to „gatunek” aplikacji wykorzystujących sztuczną inteligencję do modyfikowania zdjęć i filmów.

- Zagrożenia obejmują oglądanie nieodpowiednich treści, znęcanie się, znęcanie się i wpływ na zdrowie psychiczne.

- Badanie przeprowadzone przez Graphika wykazało 2000% wzrost liczby spamowych linków polecających do witryn „deepnude”.

- Generowanie i rozpowszechnianie „intymnych” deepfake’ów jest obecnie nielegalne.

- Profilaktyczne rozmowy na temat rozbierania sztucznej inteligencji mogą powstrzymać dzieci od angażowania się.

- Znajdź więcej materiałów wspierających bezpieczeństwo dzieci w Internecie.

Czym jest „rozbieranie AI”?

Undress AI opisuje rodzaj narzędzia wykorzystującego sztuczną inteligencję do usuwania ubrań osób na zdjęciach.

Chociaż sposób działania każdej aplikacji lub witryny może się różnić, wszystkie oferują tę podobną usługę. Chociaż zmanipulowany obraz w rzeczywistości nie przedstawia prawdziwego nagiego ciała ofiary, może to sugerować.

Sprawcy korzystający z narzędzi AI do rozbierania mogą zachować zdjęcia dla siebie lub udostępnić je szerzej. Mogliby użyć tych obrazów do przymus seksualny (sextortion), znęcanie się/wykorzystywanie lub jako forma porno zemsty.

Dzieci i młodzież narażają się na dodatkową krzywdę, jeśli ktoś „rozbierze” je przy użyciu tej technologii. A raport Fundacji Internet Watch Znaleziono ponad 11,000 3,000 potencjalnie przestępczych obrazów dzieci wygenerowanych przez sztuczną inteligencję na jednym z ciemnych forów internetowych poświęconych materiałom przedstawiającym wykorzystywanie seksualne dzieci (CSAM). Ocenili około XNUMX zdjęć jako przestępcze.

IWF stwierdziła, że znalazła także „wiele przykładów obrazów wygenerowanych przez sztuczną inteligencję, przedstawiających znane ofiary i sławne dzieci”. Generatywna sztuczna inteligencja może tworzyć przekonujące obrazy tylko wtedy, gdy uczy się na podstawie dokładnego materiału źródłowego. Zasadniczo narzędzia AI generujące CSAM musiałyby uczyć się na prawdziwych obrazach przedstawiających wykorzystywanie dzieci.

Ryzyko, na które należy zwrócić uwagę

Narzędzia Undress AI używają sugestywnego języka, aby przyciągnąć użytkowników. W związku z tym dzieci chętniej podążają za swoją ciekawością w oparciu o ten język.

Dzieci i młodzież mogą jeszcze nie rozumieć prawa. W związku z tym mogą mieć trudności z oddzieleniem szkodliwych narzędzi od tych, które promują nieszkodliwą zabawę.

Niewłaściwe treści i zachowanie

Ciekawość i nowość narzędzia AI do rozbierania mogą narazić dzieci niewłaściwa zawartość. Ponieważ nie pokazuje „prawdziwego” nagiego zdjęcia, mogą pomyśleć, że korzystanie z tych narzędzi jest w porządku. Jeśli następnie udostępnią to zdjęcie znajomym „dla śmiechu”, prawdopodobnie nieświadomie łamią prawo.

Bez interwencji rodzica lub opiekuna dziecko może kontynuować to zachowanie, nawet jeśli rani to innych.

Zagrożenia dotyczące prywatności i bezpieczeństwa

Wiele legalnych narzędzi generatywnej sztucznej inteligencji wymaga płatności lub subskrypcji w celu tworzenia obrazów. Jeśli więc witryna deepnude jest bezpłatna, może generować obrazy niskiej jakości lub mieć luźne zabezpieczenia. Jeśli dziecko prześle zdjęcie siebie lub znajomego w ubraniu, witryna lub aplikacja może je niewłaściwie wykorzystać. Obejmuje to również „głęboką nagość”, którą tworzy.

Dzieci korzystające z tych narzędzi prawdopodobnie nie przeczytają Warunków korzystania z usług ani Polityki prywatności, więc ryzykują, że mogą ich nie zrozumieć.

Tworzenie materiałów przedstawiających wykorzystywanie seksualne dzieci (CSAM)

IWF poinformowało również, że przypadki „samodzielnie wygenerowany” CSAM krążący w Internecie wzrósł o 417% od 2019 r. do 2022 r. Należy pamiętać, że termin „samogenerowany” jest niedoskonały, ponieważ w większości przypadków sprawcy zmuszają dzieci do tworzenia takich obrazów.

Jednak przy użyciu rozbieranej sztucznej inteligencji dzieci mogą nieświadomie tworzyć CSAM generowane przez sztuczną inteligencję. Jeśli prześlą zdjęcie siebie lub innego dziecka w ubraniu, ktoś może „nagodzić” to zdjęcie i udostępnić je szerzej.

Cyberprzemoc, molestowanie i molestowanie

Podobnie jak inne rodzaje deepfakes, ludzie mogą używać narzędzi AI do rozbierania się lub „deepnudes”, aby znęcać się nad innymi. Może to obejmować twierdzenie, że rówieśnik przesłał swoje nagie zdjęcie, choć tak nie było. Może to również obejmować wykorzystanie sztucznej inteligencji do stworzenia aktu z cechami, z których następnie drwią prześladowcy.

Należy o tym pamiętać udostępnianie nagich zdjęć rówieśnikom jest zarówno nielegalne, jak i obraźliwe.

Jak powszechna jest technologia „deepnude”?

Badania pokazują, że wzrasta wykorzystanie tego typu narzędzi sztucznej inteligencji, zwłaszcza do usuwania ubrań z ofiar płci żeńskiej.

Jedna z witryn poświęconych rozbieranej sztucznej inteligencji twierdzi, że ich technologia „nie była przeznaczona do stosowania w przypadku mężczyzn”. Dzieje się tak, ponieważ przeszkolili narzędzie przy użyciu wizerunków kobiet, co ma miejsce w przypadku większości tego typu narzędzi AI. W przypadku CSAM generowanego przez sztuczną inteligencję zbadaną przez Internet Watch Foundation 99.6% z nich przedstawiało także dzieci płci żeńskiej.

Badania z Graphiki podkreślono wzrost o 2000% spamu z linkami polecającymi do usług Undress AI w 2023 r. W raporcie stwierdzono również, że w ciągu miesiąca ich witryny internetowe 34 z tych dostawców odwiedziło ponad 24 miliony unikalnych użytkowników. Przewidują „dalsze przypadki szkód w Internecie”, w tym molestowanie seksualne i CSAM.

Sprawcy prawdopodobnie w dalszym ciągu będą atakować dziewczęta i kobiety, a nie chłopców i mężczyzn, zwłaszcza jeśli narzędzia te będą uczyć się głównie na wizerunkach kobiet.

Co mówi prawo brytyjskie?

Do niedawna osoby tworzące fałszywe obrazy o charakterze jednoznacznie seksualnym nie łamały prawa, chyba że przedstawiały dzieci.

Ministerstwo Sprawiedliwości ogłosiło jednak nowe prawo w tym tygodniu to to zmieni. Zgodnie z nowym prawem osoby tworzące fałszywe obrazy dorosłych o charakterze jednoznacznie seksualnym bez ich zgody będą ścigane. Skazanym również grozi „nieograniczona grzywna”.

Jest to sprzeczne z A oświadczenie złożone na początku 2024 r. Stwierdzono, że tworzenie fałszywego, intymnego wizerunku „nie jest na tyle szkodliwe ani zawinione, aby stanowić przestępstwo”.

Jeszcze w zeszłym roku sprawcy mogli tworzyć oraz udostępniaj te zdjęcia (dorosłych) bez łamania prawa. Jednakże Ustawa o bezpieczeństwie online w styczniu 2024 r. nielegalne było udostępnianie intymnych obrazów generowanych przez sztuczną inteligencję bez zgody.

Ogólnie rzecz biorąc, to prawo powinno obejmować wszelkie obrazy o charakterze seksualnym. Dotyczy to również tych, które przedstawiają nagie lub częściowo nagie osoby.

Należy jednak zauważyć, że prawo to opiera się na zamiarze wyrządzenia szkody. Zatem osoba tworząca deepfake o charakterze jednoznacznie seksualnym musi to zrobić, aby upokorzyć ofiarę lub w inny sposób zaszkodzić jej. Problem w tym, że dość trudno jest udowodnić zamiar. W związku z tym faktyczne ściganie stron tworzących deepfake o charakterze jednoznacznie seksualnym może być trudne.

Jak chronić dzieci przed rozbieraniem się AI

Niezależnie od tego, czy obawiasz się, że Twoje dziecko będzie korzystało z narzędzi AI do rozbierania się, czy też stanie się ich ofiarą, oto kilka działań, które możesz podjąć, aby je chronić.

Przeprowadź pierwszą rozmowę

Ponad jedna czwarta dzieci w Wielkiej Brytanii twierdzi, że widziała pornografię przed ukończeniem 11. roku życia. Jedno na dziesięć twierdzi, że po raz pierwszy zobaczyło pornografię w wieku 9 lat. Ciekawość może skłonić dzieci do poszukiwania narzędzi sztucznej inteligencji. Dlatego zanim dojdą do tego punktu, ważne jest, aby porozmawiać o odpowiednich treściach, pozytywnych relacjach i zdrowych zachowaniach.

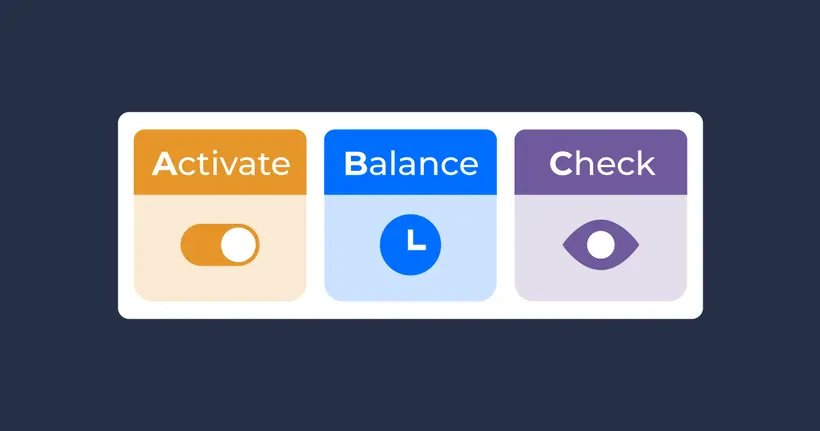

Ustaw limity witryn i aplikacji

Blokuj witryny internetowe i ustawiaj ograniczenia dotyczące treści w sieciach szerokopasmowych i komórkowych, a także na urządzeniach i aplikacjach. Zmniejszy to ryzyko natknięcia się na nieodpowiednie treści podczas przeglądania Internetu. Dostęp do tych stron internetowych może być częścią szerszej rozmowy z Tobą.

Buduj cyfrową odporność dzieci

Odporność cyfrowa to umiejętność, którą dzieci muszą rozwijać. Oznacza to, że mogą zidentyfikować potencjalne szkody w Internecie i w razie potrzeby podjąć działania. Wiedzą, jak zgłaszać, blokować i krytycznie myśleć o treściach, z którymi się spotykają. Obejmuje to wiedzę, kiedy potrzebują pomocy rodzica, opiekuna lub innej zaufanej osoby dorosłej.

Zasoby umożliwiające dalsze wsparcie

Dowiedz się więcej o sztucznej inteligencji i znajdź zasoby, aby wesprzeć ofiary rozbieranej sztucznej inteligencji.

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo

Zamknij wideo