A inteligência artificial continua a aumentar em capacidade e tecnologia. Undress AI é um exemplo que pode deixar os jovens expostos a danos.

Saiba o que é para proteger melhor seu filho online.

Resumo

- Undress AI é um ‘gênero’ de aplicativos que usa inteligência artificial para alterar imagens ou vídeos.

- Os riscos incluem ver conteúdo impróprio, bullying, abuso e impactos na saúde mental.

- Uma pesquisa da Graphika mostrou um aumento de 2000% nos links de referência de spam para sites 'deepnude'.

- Agora é ilegal gerar e distribuir deepfakes “íntimos”.

- Conversas preventivas sobre IA de despir-se podem impedir que as crianças se envolvam.

- Encontre mais recursos para apoiar a segurança online das crianças.

O que é 'Undress AI'?

Undress AI descreve um tipo de ferramenta que usa inteligência artificial para remover roupas de indivíduos em imagens.

Embora o funcionamento de cada aplicativo ou site possa variar, todos eles oferecem esse serviço semelhante. Embora a imagem manipulada não mostre realmente o corpo nu real da vítima, ela pode sugerir isso.

Os perpetradores que usam ferramentas de IA para tirar a roupa podem manter as imagens para si ou compartilhá-las de forma mais ampla. Eles poderiam usar essas imagens para coerção sexual (sextorsão), intimidação/abuso ou como forma de pornografia de vingança.

As crianças e os jovens enfrentam danos adicionais se alguém os “despir” utilizando esta tecnologia. A relatório da Internet Watch Foundation encontraram mais de 11,000 imagens de crianças potencialmente criminosas geradas por IA em um fórum da dark web dedicado a material de abuso sexual infantil (CSAM). Eles avaliaram cerca de 3,000 imagens como criminosas.

A IWF disse que também encontrou “muitos exemplos de imagens geradas por IA apresentando vítimas conhecidas e crianças famosas”. A IA generativa só pode criar imagens convincentes se aprender com material de origem preciso. Essencialmente, as ferramentas de IA que geram CSAM precisariam aprender com imagens reais de abuso infantil.

Riscos a serem observados

As ferramentas Undress AI usam linguagem sugestiva para atrair os usuários. Como tal, é mais provável que as crianças sigam sua curiosidade com base nessa linguagem.

As crianças e os jovens podem ainda não compreender a lei. Como tal, podem ter dificuldade em separar as ferramentas prejudiciais daquelas que promovem a diversão inofensiva.

Conteúdo e comportamento inadequados

A curiosidade e a novidade de uma ferramenta de IA para tirar a roupa podem expor as crianças a conteúdo inapropriado. Como não mostra uma imagem de nudez “real”, eles podem pensar que não há problema em usar essas ferramentas. Se eles compartilharem a imagem com seus amigos 'para rir', provavelmente estarão infringindo a lei sem saber.

Sem a intervenção dos pais ou responsáveis, eles podem continuar com o comportamento, mesmo que isso prejudique outras pessoas.

Riscos de privacidade e segurança

Muitas ferramentas legítimas de IA generativa exigem pagamento ou assinatura para criar imagens. Portanto, se um site deepnude for gratuito, ele poderá produzir imagens de baixa qualidade ou ter segurança negligente. Se uma criança enviar uma imagem vestida dela mesma ou de um amigo, o site ou aplicativo poderá fazer uso indevido dela. Isso inclui o ‘deepnude’ que ele cria.

É pouco provável que as crianças que utilizam estas ferramentas leiam os Termos de Serviço ou a Política de Privacidade, pelo que correm o risco de não compreenderem.

Criação de material de abuso sexual infantil (CSAM)

A IWF também informou que casos de CSAM 'autogerado' circulando on-line aumentou 417% de 2019 a 2022. Observe que o termo “autogerado” é imperfeito, pois, na maioria dos casos, os abusadores coagem as crianças a criar essas imagens.

No entanto, com o uso da IA de despir-se, as crianças podem, sem saber, criar CSAM gerado por IA. Se eles carregarem uma foto sua ou de outra criança vestida, alguém poderá “nudificar” essa imagem e compartilhá-la de forma mais ampla.

Cyberbullying, abuso e assédio

Assim como outros tipos de deepfakes, as pessoas podem usar ferramentas de IA para despir-se ou ‘deepnudes’ para intimidar outras pessoas. Isso pode incluir alegar que um colega enviou uma imagem sua nua, mas não o fez. Ou pode incluir o uso de IA para criar um nu com características que os intimidadores zombam.

É importante lembrar que compartilhar imagens nuas de colegas é ilegal e abusivo.

Quão difundida é a tecnologia "nudez profunda"?

A investigação mostra que a utilização deste tipo de ferramentas de IA está a aumentar, especialmente para remover roupas de vítimas do sexo feminino.

Um site de IA diz que sua tecnologia “não se destina ao uso com indivíduos do sexo masculino”. Isso ocorre porque eles treinaram a ferramenta usando imagens femininas, o que é verdade para a maioria desses tipos de ferramentas de IA. Com o CSAM gerado por IA que a Internet Watch Foundation investigou, 99.6% deles também apresentavam crianças do sexo feminino.

Pesquisa da Graphika destacou um aumento de 2000% no spam de links de referência para serviços de IA de nudez em 2023. O relatório também descobriu que 34 desses provedores receberam mais de 24 milhões de visitantes únicos em seus sites em um mês. Eles prevêem “outros casos de danos online”, incluindo sextorção e CSAM.

É provável que os perpetradores continuem a visar raparigas e mulheres em detrimento de rapazes e homens, especialmente se estas ferramentas aprenderem principalmente com imagens femininas.

O que diz a lei do Reino Unido?

Até recentemente, aqueles que criavam imagens deepfake sexualmente explícitas não infringiam a lei, a menos que as imagens fossem de crianças.

No entanto, o Ministério da Justiça anunciou uma nova lei esta semana isso vai mudar isso. De acordo com a nova lei, aqueles que criarem imagens sexualmente explícitas de adultos sem o seu consentimento serão processados. Os condenados também enfrentarão uma “multa ilimitada”.

Isto contradiz uma declaração feita no início de 2024. Afirmou que a criação de uma imagem íntima falsa “não era suficientemente prejudicial ou culposa para constituir uma ofensa criminal”.

Ainda no ano passado, os perpetradores podiam criar e compartilhe essas imagens (de adultos) sem infringir a lei. No entanto, o Lei de Segurança Online tornou ilegal o compartilhamento de imagens íntimas geradas por IA sem consentimento em janeiro de 2024.

Geralmente, esta lei deve abranger qualquer imagem de natureza sexual. Isso inclui aqueles que apresentam assuntos nus ou parcialmente nus.

Uma coisa a notar, no entanto, é que esta lei se baseia na intenção de causar danos. Portanto, uma pessoa que cria um deepfake sexualmente explícito deve fazê-lo para humilhar ou prejudicar a vítima. O problema com isso é que é bastante difícil provar a intenção. Como tal, pode ser difícil processar realmente as partes que criam deepfakes sexualmente explícitos.

Como manter as crianças protegidas da IA

Se você está preocupado com o fato de seu filho usar ferramentas de IA para despir ou se tornar uma vítima, aqui estão algumas ações que você pode tomar para protegê-lo.

Tenha a primeira conversa

Mais de um quarto das crianças do Reino Unido relatam ter visto pornografia aos 11 anos. Uma em cada dez afirma que viu pornografia pela primeira vez aos 9 anos. Portanto, antes de chegarem a esse ponto, é importante falar sobre conteúdos adequados, relacionamentos positivos e comportamentos saudáveis.

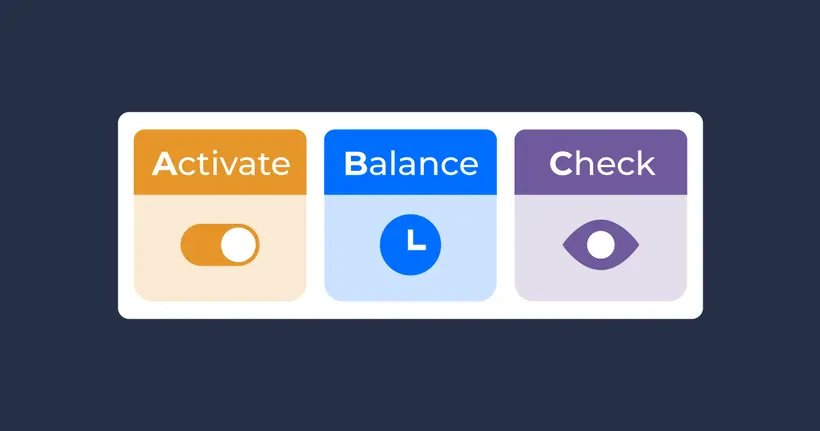

Defina limites de sites e aplicativos

Bloqueie sites e defina restrições de conteúdo em redes móveis e de banda larga, bem como em dispositivos e aplicativos. Isso reduzirá a chance de eles encontrarem conteúdo impróprio enquanto exploram online. Acessar esses sites pode fazer parte de uma conversa mais ampla com você.

Construir a resiliência digital das crianças

A resiliência digital é uma habilidade que as crianças devem desenvolver. Isso significa que eles podem identificar possíveis danos online e tomar medidas, se necessário. Eles sabem como denunciar, bloquear e pensar criticamente sobre o conteúdo que encontram. Isto inclui saber quando precisam de ajuda dos pais, responsáveis ou outro adulto de confiança.

Recursos para suporte adicional

Saiba mais sobre inteligência artificial e encontre recursos para apoiar vítimas de IA sem roupa.

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo

Fechar vídeo