Компания Internet Matters рада принять участие в этой долгожданной консультации. У нас есть несколько вводных комментариев, которые формируют наше мышление, прежде чем мы перейдем к конкретным вопросам. Internet Matters существует для того, чтобы помочь семьям извлечь выгоду из подключенных технологий. Мы некоммерческая организация, финансируемая интернет-индустрией, и мы рады объединить ведущие бренды, чтобы сосредоточить внимание на безопасности детей и цифровом благополучии. Мы предоставляем родителям профессиональные консультации, представленные в удобной форме, в зависимости от возраста ребенка, устройства, приложения, платформы или проблемы.

Мы знаем, что взаимодействие с нашим контентом дает родителям, опекунам и все более профессиональным специалистам уверенность и инструменты, необходимые для участия в цифровой жизни тех, кто им небезразличен. Вовлеченный взрослый в жизнь ребенка является самым важным фактором обеспечения его безопасности в сети, поэтому предоставление этим взрослым инструментам, ресурсам и уверенности для действий является фундаментальной частью цифровой грамотности.

Нормативная база и сложности для родителей

AVMSD вытекает из свода законов ЕС, основанного на принципе «страны происхождения». На практике это означает, что, как указано в консультативном документе, временная нормативная база будет охватывать 6 основных сайтов и 2 сайта с контентом для взрослых. Это будет очень сложно объяснить родителям, которые могли бы справедливо ожидать, что если контент доступен для просмотра в Великобритании, это регулируется в Великобритании.

Признавая ограничения AVMSD, участники консультации неоднократно отмечали, что в той мере, в какой предстоящее законодательство о вреде в Интернете будет касаться несоответствующего возрасту контента, оно не будет чувствовать себя обязанным соблюдать принцип страны происхождения. Мы поддерживаем эту позицию. Если контент доступен для просмотра в Великобритании, то он должен соответствовать правилам Великобритании.

Однако существует несоответствие между заявленными целями «Белой книги о вреде онлайн» и объемом AVMSD. В Белой книге в основном говорится о платформах, которые позволяют публиковать контент, созданный пользователями. AVMSD этим не ограничивается. В этом случае AVMSD понял это правильно. Нет смысла ограничивать сферу действия законодательства о вреде в Интернете платформами, которые позволяют публиковать контент, созданный пользователями. Важен характер контента, а не то, как и кем он был создан.

Вопрос 19: Какие есть примеры эффективного использования и реализации любых мер, перечисленных в статье 28 (b) (3) AVMSD 2018? К этим мерам относятся сроки и условия, механизмы отметки и отчетности, системы проверки возраста, системы рейтингов, системы родительского контроля, легкодоступные функции подачи жалоб, а также меры и инструменты для повышения уровня медиаграмотности. Приведите доказательства и конкретные примеры, подтверждающие ваш ответ.

Наша работа, прислушиваясь к мнению семей, определяет все, что мы делаем - и, учитывая, что мы являемся ключевой частью обеспечения цифровой грамотности для родителей, мы хотели поделиться с вами некоторыми мыслями. Родители обращаются за советом по поводу безопасности в Интернете, когда происходит одно из четырех:

- Дома есть новое устройство

- На устройстве установлено новое приложение / платформа

- Дети идут в среднюю школу

- Существует проблема безопасности, которая может быть вызвана любым количеством причин, не в последнюю очередь жизненным опытом, подсказками из школы, историями из СМИ и т. Д.

Чаще всего родители обращаются за помощью через онлайн-поиск или просят о помощи в школе. Очевидно, что во время изоляции поиск решений был более важным, а это означает, что рекомендации надежных организаций, основанные на доказательствах, должны быть на вершине рейтинга.

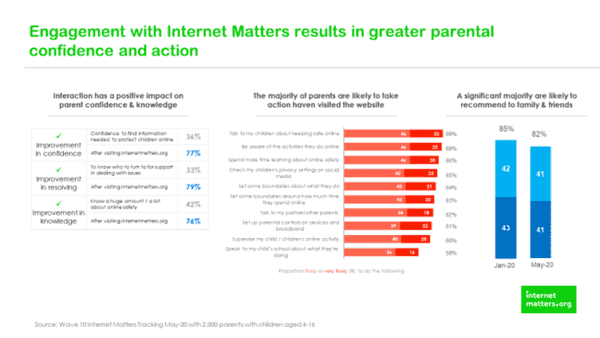

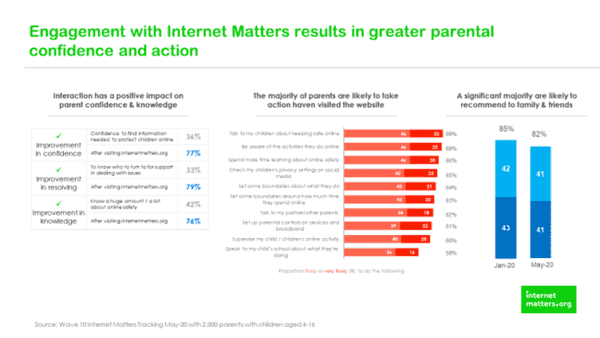

После того, как родители начнут давать советы, их должно быть легко понять - поэтому мы регулярно опрашиваем родителей о том, что, по их мнению, будут говорить и что они будут делать по-другому после посещения нашего веб-сайта. Приведенные ниже диаграммы демонстрируют, что предоставление родителям контента, отвечающего их требованиям, приводит к значимым и измеримым изменениям.

Эти данные указывают на то, что на цифровую грамотность среди родителей могут влиять качественные ресурсы, которые позволяют им вести рутинные беседы со своими детьми об их цифровой жизни. Более того, наши страницы, посвященные родительскому контролю, стабильно входят в десятку самых популярных страниц.

Вопрос 20: Какие есть примеры мер, которые не оправдали ожиданий в отношении защиты пользователей и почему? По возможности предоставьте доказательства, подтверждающие ваш ответ.

Мы должны сделать вывод, что модерация потокового вещания в настоящее время не работает и, возможно, не может работать, нарушение условий и положений платформ происходит в режиме реального времени. В следующих двух примерах не просто отказались от сроков и условий, это было гораздо серьезнее. Недавнее трагическое самоубийство распространилось по всему миру в считанные секунды, и, хотя платформы предприняли быстрые и решительные действия, слишком многие люди увидели этот мучительный контент в основных приложениях, практически без предупреждения относительно графического контента. Как мы все знаем, это был не единственный пример неудачной модерации прямых трансляций, как показали съемки в Крайстчерче еще в марте 2019 года.

Ясно, что это сложные проблемы, когда кто-то намеренно стремится разрушить жизни своими собственными действиями и своим решением транслировать это в прямом эфире. Конечно, эти два примера несопоставимы, за исключением того, что мы можем извлечь из них и что регулирующий орган может осмысленно сделать в этих ситуациях. Возможно, именно в очень экстремальном и исключительном характере этого контента можно найти комфорт - почти в любых других обстоятельствах этот контент идентифицируется и изолирован в моменты между загрузкой и отправкой. Очевидно, что это решения за доли секунды, которые зависят от выдающихся алгоритмов и квалифицированных модераторов. Возможно, роль регулирующего органа в этой ситуации состоит в том, чтобы работать с платформами, на которые такой контент может быть или был загружен, просмотрен и распространен, чтобы понять и изучить, что пошло не так, а затем согласовать конкретные действия, чтобы этого больше не повторилось. Возможно, регулирующий орган мог бы конфиденциально поделиться этими знаниями с другими платформами просто для того, чтобы уроки были извлечены как можно шире - для защиты общества и, где это уместно, для возмещения ущерба со стороны компании. Для этого для работы культура регулирующего органа и его подход должны быть совместными и заинтересованными, а не удаленными и карательными.

Рекомендации, которые регулирующий орган может пожелать внедрить, могут включать (но не ограничиваться этим) запрашивающие компании, разработавшие планы совместной работы для обеспечения немедленного обмена уведомлениями между платформами, поскольку хранение этой информации на одной платформе не дает коммерческих преимуществ.

Другой вопрос, который требует подробного рассмотрения, - это комментарии под видео - будь то малыши в детском бассейне или подростки, синхронизирующие по губам музыкальные клипы. Возможно, здесь есть две отдельные проблемы. Что касается аккаунтов молодых людей в возрасте от 13 до 16 лет, если и до тех пор, пока анонимность в Интернете не перестанет существовать, «платформы следует поощрять осторожно подходить к комментариям, удаляя все, о чем сообщается, и восстанавливая их после того, как комментарий был подтвержден».

Мы призываем регулирующий орган продолжать работу с платформами для выявления видео, которые, хотя и невинны по своей природе, привлекают неуместные комментарии и приостанавливают возможность публичного комментирования под ними. Часто владельцы учетных записей не знают, кто оставляет комментарии, и контекст решает все. Сверстник, восхищающийся танцевальным движением или предметом одежды, существенно отличается от комментариев незнакомца.

Пока сайтам не требуется проверять возраст пользователей, прямые трансляции будут загружаться и просматриваться детьми. Дети имеют такое же право на новые технологии, как и все остальные, и должны иметь возможность безопасно пользоваться ими. Таким образом, перед регулирующим органом стоит задача обеспечить, чтобы дети, ведущие прямые трансляции, могли делать это без нежелательного контакта с посторонними лицами.

Хотя многие молодые люди говорят нам, что им нравится и ценят одобрение, которое они получают от комментариев, решение состоит не в том, чтобы сохранить функциональность. Чтобы остановить это и вложить время и деньги в понимание того, что происходит в жизни наших молодых людей, что признание незнакомцев так важно для них.

Для родителей, публикующих изображения малышей в детских бассейнах, есть как технические, так и образовательные ответы. Должна быть возможность видеть изображения только в приватном режиме, чтобы посторонние не могли комментировать. Во-вторых, для родителей должна быть образовательная игра, которая, вероятно, начинается с разговоров между будущей матерью и акушеркой о том, какую часть младенческой жизни их ребенка целесообразно публиковать в Интернете, чтобы мир мог ее увидеть. Регулирующий орган может сыграть свою роль в изменении образа жизни, основанного на шоу-роликах, который быстро стал нормой.

Вопрос 21: Какие индикаторы потенциального вреда следует учитывать в Ofcom в рамках постоянного мониторинга и соблюдения нормативных требований в отношении услуг ВСП? По возможности предоставьте доказательства, подтверждающие ваш ответ.

За последние 18 месяцев Internet Matters потратила значительное количество времени и ресурсов на изучение онлайн-опыта уязвимых детей - в частности, того, чем они отличаются от их неуязвимых сверстников. Наш отчет Уязвимые дети в цифровом мире опубликованная в феврале 2019 года, показала, что уязвимые дети имеют совершенно другой опыт работы в Интернете. Дальнейшие исследования показывают, что дети и молодые люди с SEND подвергаются особому риску, поскольку они менее способны критически оценивать контактные риски и с большей вероятностью верят, что люди такие, какими они себя называют. Точно так же дети, испытывающие заботу о себе, больше подвержены риску увидеть вредный контент, особенно контент о самоповреждении и самоубийстве. Есть еще много примеров.

Дело здесь не в том, что уязвимые молодые люди должны иметь отдельный опыт, если они идентифицируют себя с платформами, но больше, чем регулирующий орган и платформы признают, что миллионы уязвимых детей в Великобритании нуждаются в дополнительной поддержке, чтобы воспользоваться подключенными технологиями. Характер поддержки будет различаться, но неизбежно будет включать в себя дополнительные специальные меры по повышению цифровой грамотности, а также улучшенную модерацию контента для удаления опасного контента перед его распространением.

Данные Cybersurvey 2019, проведенного Youthworks в партнерстве с Internet Matters, показывают:

- Молодые люди все чаще сталкиваются с вредоносным контентом, в котором говорится о самоубийстве или членовредительстве. В 2019 году четверть респондентов-подростков когда-либо видели контент о самоубийстве, а 13% видели контент о самоповреждении. В 2015 году 11% когда-либо видели контент, призывающий к самоповреждению или самоубийству.

- Процент тех, кто лично испытал на себе расистские издевательства или агрессию в Интернете в 2019 году, выше, чем в 2015 году; 13% по сравнению с 4%

- Процент тех, кто лично испытал гомофобные издевательства или агрессию в Интернете в 2019 году, почти в четыре раза выше, чем в 2015 году; 15% по сравнению с 4%

- Риск содержания встречается чаще, чем риск контакта:

- К материалам в поддержку анорексии, которые мы отметили в нескольких предыдущих отчетах Cybersurvey, в этом году добавились материалы, побуждающие подростков «набрать массу». Это широко видно, в основном, мальчиками. (Хотя физическая подготовка положительна, набор массы тела может быть вредным, если для этого молодому человеку рекомендуется употреблять вещества, которые могут не соответствовать маркировке)

Контент о самоповреждении «часто» видят и без того уязвимые подростки, особенно с расстройством пищевого поведения (23%) или проблемами речи (29%), тогда как только 9% молодых людей без уязвимых мест «когда-либо» видели его и только 2% делали это «часто».

Вопрос 22: AVMSD 2018 требует, чтобы ПБО принимали соответствующие меры для защиты несовершеннолетних от контента, который «может нанести ущерб их физическому, умственному или моральному развитию». Какие типы контента вы считаете релевантными для этого? Какие меры вы считаете наиболее подходящими для защиты несовершеннолетних? По возможности предоставьте доказательства, подтверждающие ваш ответ, включая любые возрастные факторы.

В дополнение к материалам о самоповреждениях и самоубийствах, подробно описанным в нашем ответе на вопрос 21, существует несколько других типов контента, которые могут повлиять на физическое, умственное или моральное развитие детей, включая (и не ограничиваясь ими):

- Порнография и весь другой контент для взрослых и сексуального характера, окружающий порнографию. Это также включает влияние этого контента на восприятие детьми здоровых отношений, согласия и роли женщин. Наш отчет - Нам нужно поговорить о порнографии подробно описывает эти проблемы в контексте поддержки родителей при проверке возраста

- Насилие - нормализация насилия и последствия контента, посвященного определенным музыкальным жанрам и культуре банд, могут быть очень разрушительными.

- Преступная деятельность - от использования VSP для вербовки несовершеннолетних для работы в округах и прославления гламурного образа жизни существует целый ряд вредоносного контента, поощряющего преступность.

- Азартные игры, курение и алкоголь, ножи - дети не должны иметь возможность играть в азартные игры в Интернете - это незаконно в автономном режиме и должно быть одновременно незаконным и невозможным в Интернете. Точно так же существуют возрастные ограничения на продажу товаров с ограничениями; табак, алкоголь и оружие, и это должно означать, что дети не могут просматривать этот контент в форме рекламы, которая его очаровывает или им предоставляется возможность купить

- Идеология / радикализация / экстремизм - хотя мы и не стремимся ограничивать свободу слова, дети и молодые люди заслуживают особой защиты, чтобы они не подвергались радикальной и крайней идеологии и содержанию.

Возможно, это можно сделать, просмотрев и обновив категории контента, которые интернет-провайдеры используют для блокировки контента с помощью фильтров родительского контроля. На весь контент, созданный пользователями, должны распространяться одни и те же ограничения для детей. Для здоровья и благополучия детей важен сам контент, а не то, был ли этот контент создан ведущей вещательной компанией или кем-то в будущем.

Какие меры наиболее подходят для защиты несовершеннолетних?

- Ограничено, некоторый контент не должен показываться некоторым аудиториям.

- Более широкое использование предупреждений на экране-заставке для выявления легального, но вредного контента

- Более драконовские действия против пользователей, которые создают контент, нарушающий положения и условия платформ.

- Проверка возраста для контента для взрослых и гарантия возраста для пользователей в возрасте 13-16 лет

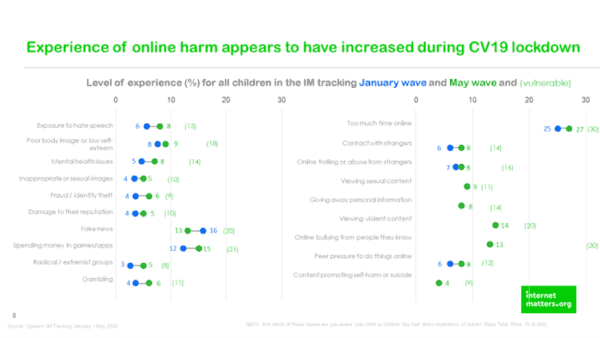

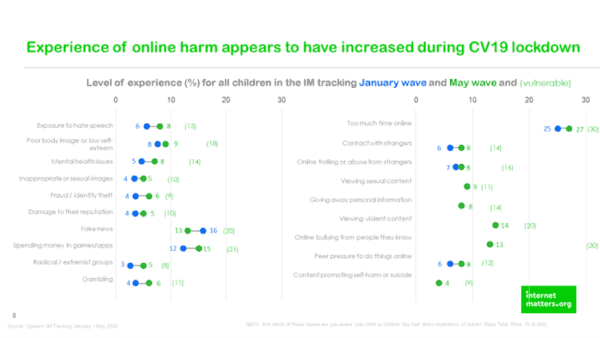

Это актуально, поскольку наши данные показывают, что во время изоляции возросло количество случаев нанесения вреда в Интернете.

Вопрос 23: С какими проблемами могут столкнуться провайдеры VSP при практическом и соразмерном принятии мер, о которых Ofcom должен знать? Нам было бы особенно интересно ваше объяснение факторов, имеющих отношение к оценке практичности и соразмерности.

Здесь может быть полезно провести различие между незаконным контентом, где есть очень четкие требования, и легальным, но вредным контентом, где царит неразбериха.

Это серьезная и сложная проблема, для решения которой потребуется значительная работа между платформами и регулирующим органом. Учитывая, что правительство намерено назначить Ofcom в качестве онлайн-регулятора вреда, будет столько же интереса как это делается, так и как это делается. Мы создадим прецеденты и создадим ожидания.

Вопрос 24: Как ПВО должны уравновешивать права своих пользователей на свободу выражения мнений и какие показатели им следует использовать для отслеживания этого? Какую роль вы видите в регулирующем органе?

- Ясность в принципах сообщества относительно того, что уместно, а что нет, и что будет приемлемо / терпимо. Злоупотребляй им, и ты уйдешь. Свобода выражения мнений не ограничивается, потому что вы можете найти другую платформу для выражения этих взглядов - но на этом они неприемлемы.

- Метрики - распространенность, удаление и отчетность

- Роль регулирующего органа заключается в обеспечении соблюдения стандартов сообщества, признание того, что, как и в случае со всеми правилами, люди будут их подталкивать и уклоняться от них, поэтому также требуется элемент человеческой умеренности и здравого смысла.

- Регулирующему органу необходимо признать, что образование также является ключевой частью этого, поэтому ПСС, инвестирующие в независимые образовательные программы, повышающие цифровую грамотность, следует поощрять / рассматривать их благосклонно / предоставлять скидку на сборы.

Вопрос 25: Как ВСП должны обеспечивать механизм внесудебной компенсации для беспристрастного урегулирования споров между пользователями и поставщиками ВСП? (см. пункт 2.32 и статью 28 (b) (7) в приложении 5). Пожалуйста, предоставьте доказательства или анализ, чтобы поддержать ваш ответ, где это возможно, включая рассмотрение того, как это требование может быть выполнено эффективным и соразмерным образом.

У Internet Matters нет комментариев по этому вопросу

Вопрос 26: Каким образом Ofcom может наилучшим образом поддерживать ВСП, чтобы продолжать внедрять инновации для обеспечения безопасности пользователей?

- Признать вложения в приложения и меры по повышению медийной / цифровой грамотности, которые могут продемонстрировать влияние посредством надежной оценки

- Убедитесь, что они понимают, что соблюдение требований - это больше, чем удаление контента - как и в ирландской модели, оно должно включать меры по минимизации распространения и увеличения вредоносного контента.

- Четко сформулируйте цель требований - где, опять же в соответствии с ирландской моделью, существует цикл минимизации вреда, при котором количество людей, подвергающихся воздействию вредоносного контента, со временем значительно сокращается в результате принимаемых мер.

- Сделайте сообщение о проблемном контенте таким же простым, как загрузка контента, и держите журналистов в курсе процессов и возможных сроков решения. Это должно включать четко опубликованное время ответа, которое соответствует минимальным стандартам и информирует пользователей. Кроме того, мы подозреваем, что некоторые формулировки, касающиеся сообщения о контенте, отталкивают детей, поэтому предполагаем, что будет проделана определенная работа по определению наиболее подходящей формулировки и процесса для молодых людей, чтобы они с большей вероятностью отметили этот контент. Кроме того, со стороны платформ должны быть постоянные усилия по восстановлению доверия к их механизмам отчетности, чтобы пользователи всех возрастов верили, что что-то произойдет, если они сделают отчет.

- Упростите создание отчетов для несовершеннолетних - поэтому протестируйте вместе с ними наиболее подходящий способ сделать это с помощью платформы. Является ли сложный конкретный язык лучшим для молодежи, или более мягкий язык, такой как «Мне это не нравится» или «это содержание делает меня несчастным», будет более эффективным? Кроме того, уделите приоритетное внимание их проблемам и, возможно, рассмотрите, что произойдет, если отчеты несовершеннолетних будут удалены, а затем изучены и восстановлены, если это необходимо. Если бы мы действительно хотели сделать Интернет безопасным местом для детей, мы бы сосредоточились на их потребностях - на платформах, которые они, вероятно, будут часто посещать.

Вопрос 27: Каким образом Ofcom может наилучшим образом поддержать предприятия в соответствии с новыми требованиями?

- Признайте ограничения в объеме и сроках выполнения требований - и сообщите о них соответствующим образом. Если правила распространяются только на 6 или 8 организаций, не переусердствуйте - они не будут лидерами в мире. Это важно, чтобы родители реалистично оценивали, какие изменения повлекут за собой требования, и не становились менее бдительными из-за того, что они верят, что существует регулируемое решение.

- Признайте, что размер не является предпосылкой существования риска и вреда, и что в любой другой сфере потребительских товаров бизнес не может выпускать на рынок менее безопасные или более рискованные продукты, потому что они маленькие. К микропивоварням предъявляются те же юридические требования, что и к Coca-Cola, по соблюдению всех соответствующих норм в области здравоохранения и безопасности. То же самое и с производителями игрушек и продюсерами фильмов. Право быть в безопасности или в этом случае не пострадать является абсолютным и не зависит от размера организации, в которой вы потребляете продукт или услугу.

Вопрос 28: Есть ли у вас какие-либо взгляды на набор принципов, изложенных в параграфе 2.49 (защита и гарантии, свобода выражения мнений, адаптируемость с течением времени, прозрачность, надежное правоприменение, независимость и соразмерность), а также на уравновешивание противоречий, которые могут иногда возникать между их?

- В предложениях Ирландии признается, что это итеративный процесс, поэтому приветствуем стремление к гибкости и новаторству. Основное внимание уделяется регулированию в соответствии с кодексами, а не личным поведением - но все же нужно место для обучения, чтобы поведение было обращено. Текущая консультация Юридической комиссии по онлайн-преступлениям также является интересным мероприятием, поскольку такие изменения в законе внесут правовую и, следовательно, культурную ясность в отношении того, что является приемлемым и законным поведением в Интернете.

- Проблемы, связанные со свободой слова и самовыражения, можно решить с помощью положений и условий - так что может быть место, где приветствуются ваши крайние взгляды, - но это не подходящая платформа для этого. Не предлагать, чтобы вы не могли выражать эти взгляды, а просто заявляли, что вы не можете этого делать на этой платформе.

- Признание проблем, связанных с проверкой возраста несовершеннолетних и допустимой погрешностью при проверке возраста, а также неизбежных ограничений этих технологий.