L'intelligence artificielle continue de croître en capacité et en technologie. Undress AI est un exemple qui pourrait exposer les jeunes à des dangers.

Découvrez de quoi il s’agit afin de mieux protéger votre enfant en ligne.

Résumé

- Undress AI est un « genre » d'applications qui utilisent l'intelligence artificielle pour modifier des images ou des vidéos.

- Les risques incluent la visualisation de contenus inappropriés, l’intimidation, les abus et les impacts sur la santé mentale.

- Une étude de Graphika a montré une augmentation de 2000 XNUMX % des liens de renvoi de spam vers des sites Web « deepnude ».

- Il est désormais illégal de générer et de distribuer des deepfakes « intimes ».

- Les conversations préventives sur le déshabillage de l’IA peuvent empêcher les enfants de s’impliquer.

- Trouvez davantage de ressources pour soutenir la sécurité des enfants en ligne.

Qu'est-ce que « déshabiller l'IA » ?

Undress AI décrit un type d'outil qui utilise l'intelligence artificielle pour retirer les vêtements d'individus dans les images.

Bien que le fonctionnement de chaque application ou site Web puisse varier, tous offrent ce service similaire. Bien que l’image manipulée ne montre pas réellement le corps nu réel de la victime, cela peut l’impliquer.

Les auteurs de violences qui utilisent des outils d’IA de déshabillage peuvent conserver les images pour eux-mêmes ou les partager plus largement. Ils pourraient utiliser ces images pour contrainte sexuelle (sextorsion), d'intimidation/d'abus ou comme forme de vengeance pornographique.

Les enfants et les jeunes risquent un préjudice encore plus grand si quelqu'un les « déshabille » à l'aide de cette technologie. UN rapport de l'Internet Watch Foundation a trouvé plus de 11,000 3,000 images d’enfants potentiellement criminelles générées par l’IA sur un forum du Dark Web dédié au matériel d’abus sexuel sur enfants (CSAM). Ils ont évalué environ XNUMX XNUMX images comme criminelles.

L’IWF a déclaré avoir également trouvé « de nombreux exemples d’images générées par l’IA mettant en scène des victimes connues et des enfants célèbres ». L’IA générative ne peut créer des images convaincantes que si elle apprend à partir de sources précises. Essentiellement, les outils d’IA qui génèrent du CSAM devraient apprendre d’images réelles montrant de la maltraitance d’enfants.

Des risques à surveiller

Les outils d’IA Undress utilisent un langage suggestif pour attirer les utilisateurs. En tant que tels, les enfants sont plus susceptibles de suivre leur curiosité en fonction de ce langage.

Les enfants et les jeunes ne comprennent peut-être pas encore la loi. En tant que tels, ils pourraient avoir du mal à séparer les outils nuisibles de ceux qui favorisent un divertissement inoffensif.

Contenu et comportement inappropriés

La curiosité et la nouveauté d'un outil d'IA de déshabillage pourraient exposer les enfants à contenu inapproprié. Parce qu’il ne montre pas une « vraie » image nue, ils pourraient alors penser qu’il est acceptable d’utiliser ces outils. S'ils partagent ensuite l'image avec leurs amis « pour rire », ils enfreignent probablement la loi sans le savoir.

Sans l'intervention d'un parent ou d'un tuteur, ils pourraient continuer à adopter ce comportement, même si cela blesse les autres.

Risques de confidentialité et de sécurité

De nombreux outils d’IA générative légitimes nécessitent un paiement ou un abonnement pour créer des images. Ainsi, si un site Web deepnude est gratuit, il peut produire des images de mauvaise qualité ou avoir une sécurité laxiste. Si un enfant télécharge une image habillée de lui-même ou d’un ami, le site ou l’application pourrait en faire un usage abusif. Cela inclut le « deepnude » qu’il crée.

Il est peu probable que les enfants utilisant ces outils lisent les conditions d'utilisation ou la politique de confidentialité, ils courent donc un risque qu'ils ne comprennent pas.

Création de matériel d’abus sexuel sur des enfants (CSAM)

L'IWF a également signalé que des cas de Les CSAM « auto-générés » circulant en ligne ont augmenté de 417 % de 2019 à 2022. Notez que le terme « auto-généré » est imparfait car, dans la plupart des cas, les agresseurs contraignent les enfants à créer ces images.

Cependant, avec l’utilisation de l’IA de déshabillage, les enfants peuvent sans le savoir créer du CSAM généré par l’IA. S'ils téléchargent une photo habillée d'eux-mêmes ou d'un autre enfant, quelqu'un pourrait « nudifier » cette image et la partager plus largement.

Cyberintimidation, abus et harcèlement

Tout comme d'autres types de deepfakes, les gens peuvent utiliser des outils d'IA pour se déshabiller ou des « deepnudes » pour intimider les autres. Cela pourrait inclure de prétendre qu'un pair a envoyé une image nue d'eux-mêmes alors qu'il ne l'a pas fait. Ou bien, cela pourrait inclure l’utilisation de l’IA pour créer un nu avec des caractéristiques dont les intimidateurs se moquent ensuite.

Il est important de se rappeler que partager des images nues de pairs est à la fois illégal et abusif.

Quelle est l’ampleur de la technologie « deepnude » ?

La recherche montre que l’utilisation de ces types d’outils d’IA augmente, notamment pour retirer les vêtements des victimes féminines.

Un site d’IA de déshabillage affirme que leur technologie n’était « pas destinée à être utilisée avec des sujets masculins ». En effet, ils ont formé l’outil à l’aide d’images féminines, ce qui est vrai pour la plupart de ces types d’outils d’IA. Avec les CSAM générés par l’IA sur lesquels l’Internet Watch Foundation a enquêté, 99.6 % d’entre eux présentaient également des filles.

Recherche de Graphika a mis en évidence une augmentation de 2000 2023 % du spam de liens de référence pour les services d'IA de déshabillage en 34. Le rapport a également révélé que 24 de ces fournisseurs ont reçu plus de XNUMX millions de visiteurs uniques sur leurs sites Web en un mois. Ils prédisent « d’autres cas de préjudices en ligne », notamment la sextorsion et le CSAM.

Les auteurs continueront probablement de cibler les filles et les femmes plutôt que les garçons et les hommes, surtout si ces outils s’inspirent principalement des images féminines.

Que dit la loi britannique?

Jusqu’à récemment, ceux qui créaient de fausses images sexuellement explicites n’enfreignaient la loi que si les images concernaient des enfants.

Toutefois, le ministère de la Justice a annoncé un nouvelle loi cette semaine cela va changer cela. En vertu de la nouvelle loi, ceux qui créent de fausses images sexuellement explicites d’adultes sans leur consentement seront poursuivis. Les personnes reconnues coupables seront également passibles d’une « amende illimitée ».

Cela contredit un déclaration faite début 2024. Il a déclaré que la création d’une image intime deepfake n’était « pas suffisamment nuisible ou coupable pour constituer une infraction pénale ».

Pas plus tard que l'année dernière, les auteurs pourraient créer et partagez ces images (d’adultes) sans enfreindre la loi. Cependant, le Loi sur la sécurité en ligne a rendu illégal le partage d’images intimes générées par l’IA sans consentement en janvier 2024.

De manière générale, cette loi devrait couvrir toute image à caractère sexuel. Cela inclut ceux qui présentent des sujets nus ou partiellement nus.

Il convient toutefois de noter que cette loi repose sur l’intention de causer un préjudice. Ainsi, une personne qui crée un deepfake sexuellement explicite doit le faire pour humilier ou nuire d’une autre manière à la victime. Le problème, c’est qu’il est assez difficile de prouver l’intention. En tant que tel, il pourrait être difficile de poursuivre en justice les parties créant des deepfakes sexuellement explicites.

Comment protéger les enfants contre le déshabillage AI

Que vous craigniez que votre enfant utilise des outils d'IA de déshabillage ou devienne une victime, voici quelques mesures à prendre pour le protéger.

Ayez la première conversation

Plus d'un quart des enfants britanniques déclarent avoir vu de la pornographie avant l'âge de 11 ans. Un sur dix déclare avoir vu du porno pour la première fois à 9 ans. La curiosité pourrait amener les enfants à rechercher également des outils d'IA pour se déshabiller. Donc, avant d’en arriver là, il est important de parler de contenu approprié, de relations positives et de comportements sains.

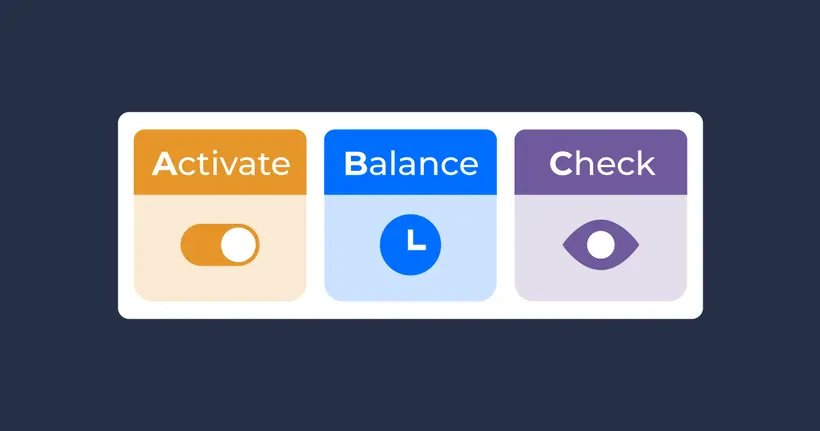

Définir les limites des sites Web et des applications

Bloquez les sites Web et définissez des restrictions de contenu sur les réseaux haut débit et mobiles, ainsi que sur les appareils et les applications. Cela réduira le risque qu’ils tombent sur du contenu inapproprié lors de leur exploration en ligne. L’accès à ces sites Web peut faire partie d’une conversation plus large avec vous.

Développer la résilience numérique des enfants

La résilience numérique est une compétence que les enfants doivent développer. Cela signifie qu’ils peuvent identifier les dommages potentiels en ligne et prendre des mesures si nécessaire. Ils savent comment signaler, bloquer et réfléchir de manière critique aux contenus qu’ils rencontrent. Cela implique de savoir quand ils ont besoin de l’aide de leur parent, de leur tuteur ou d’un autre adulte de confiance.

Ressources pour un soutien supplémentaire

Apprenez-en davantage sur l’intelligence artificielle et trouvez des ressources pour aider les victimes de l’IA déshabillée.

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo

Fermer la vidéo